Ce este un fișier robots.txt și de ce contează

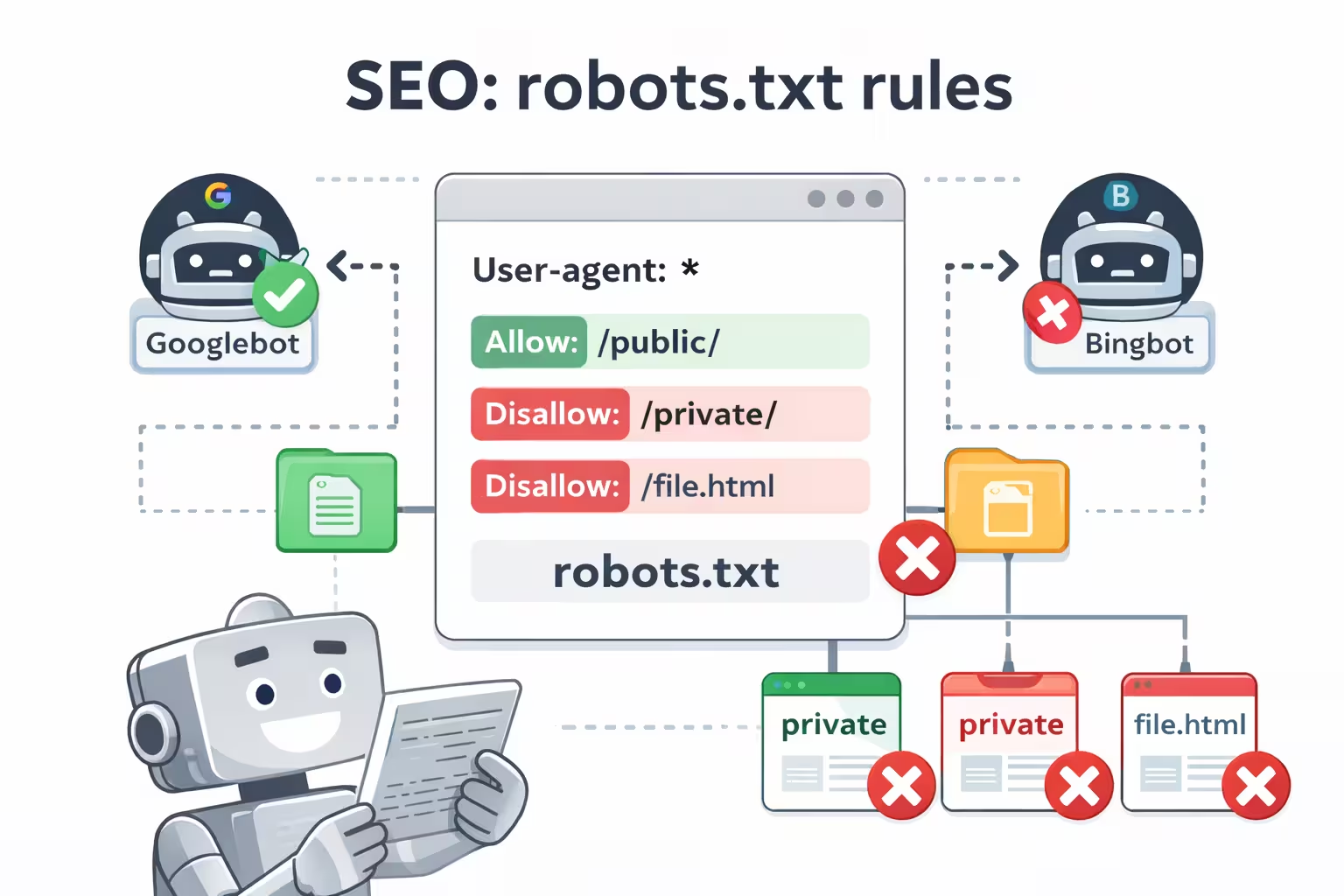

Un fișier robots.txt este un instrument mic dar puternic care le spune motoarelor de căutare cum să parcurgă site-ul tău web. Acesta conține instrucțiuni, cunoscute sub numele de directive, care indică ce pagini sau secțiuni ale site-ului tău crawlerelor li se permite să le acceseze și pe care ar trebui să le evite.

Dacă nu există un fișier robots.txt, motoarele de căutare vor încerca să parcurgă întregul site web. Deși majoritatea motoarelor de căutare importante respectă directivele robots.txt, acestea sunt considerate linii directoare și nu reguli stricte, ceea ce înseamnă că crawlerele le pot ignora uneori.

De ce robots.txt este important pentru site-ul tău

Din perspectiva SEO, robots.txt joacă un rol esențial în ghidarea modului în care motoarele de căutare interacționează cu site-ul tău. Un fișier robots.txt configurat corect te ajută să:

- Controlezi indexarea prin împiedicarea accesării robotului la pagini duplicate sau inutile

- Protejezi zonele sensibile precum paginile de autentificare, mediile de testare sau instrumentele interne

- Optimizezi resursele serverului prin reducerea traficului inutil al roboților

Important: Modificări incorecte aduse fișierului robots.txt pot face mari porțiuni din site-ul tău inaccesibile pentru motoarele de căutare, ceea ce poate afecta negativ vizibilitatea și traficul.

Provocări comune ale fișierului robots.txt

Multe site-uri web întâmpină probleme cu configurarea fișierului robots.txt. Majoritatea problemelor se încadrează în trei categorii principale:

- Utilizarea greșită a caracterelor wildcard care blochează neintenționat secțiuni importante ale site-ului

- Modificări neașteptate efectuate în timpul dezvoltării sau actualizărilor site-ului fără o revizuire adecvată

- Directive non-standard care nu sunt recunoscute de motoarele de căutare și nu au niciun efect real

Aceste probleme apar adesea deoarece robots.txt este editat manual sau ascuns în setările complexe ale pluginurilor SEO.

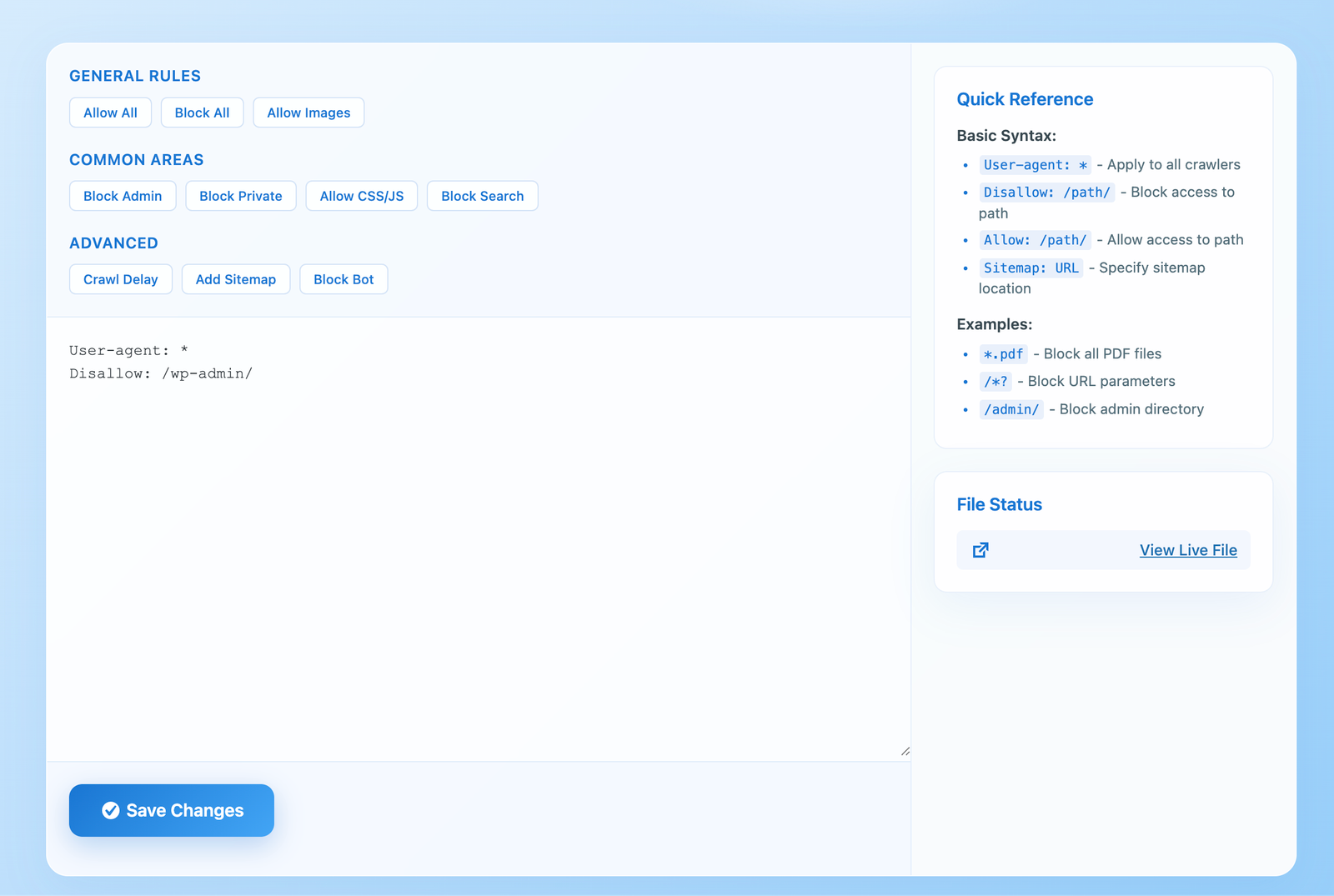

WPZone Robots este conceput pentru a face gestionarea fișierului robots.txt simplă și previzibilă pentru utilizatorii WordPress. Oferă o soluție concentrată, independentă, fără a se baza pe suite mari de plugin-uri SEO.

- Editor intuitiv direct în panoul de control WordPress

- Independent de plugin-urile SEO precum Yoast sau Rank Math

- Control manual complet asupra regulilor de acces pentru crawler-e

- Ușor și concentrat, fără funcții inutile sau umplutură SEO

WPZone Robots permite utilizatorilor ne-tehnici să gestioneze accesul crawler-elor în siguranță, oferind în același timp dezvoltatorilor și proprietarilor de site-uri un control previzibil asupra fișierului lor robots.txt.

Cele mai bune practici pentru fișierul tău robots.txt

Când creezi sau editezi fișierul tău robots.txt, ține cont de următoarele practici recomandate:

- Plasează fișierul în rădăcina domeniului tău (de ex. https://www.example.com/robots.txt)

- Evită blocarea paginilor interne importante care susțin navigarea și legăturile interne

- Limitează utilizarea directivelor precum

crawl-delay, care pot fi ignorate sau interpretate greșit - Verifică periodic fișierul robots.txt pentru a detecta modificări accidentale sau conflicte

Sfat: Robots.txt ar trebui folosit doar pentru conținutul pe care motoarele de căutare nu ar trebui să-l indexeze niciodată, cum ar fi zonele de autentificare, paginile de test sau URL-urile generate automat.

Rămâi la curent cu Wpzone

Obține cele mai recente știri!

Abonează-te la newsletter-ul nostru și fii primul care află despre noile funcționalități, actualizări și oferte exclusive pentru aplicația noastră de rezervare taxi.

We respect your privacy. Unsubscribe at any time.

Dezavantajele neutilizării robots.txt

Ce se întâmplă când accesul robotului de indexare este lăsat negestionat

Expunerea zonelor nepublice

Pagini de autentificare, secțiuni de testare sau URL-uri interne pot fi descoperite și parcurse inutil.

Control limitat asupra indexării

Robots.txt controlează parcurgerea, nu indexarea, iar motoarele de căutare pot totuși indexa URL-urile blocate.

Resurse și buget de parcurgere irosite

Parcurgerea excesivă poate consuma resursele serverului și poate reduce eficiența indexării pentru conținutul important.

Avantajele utilizării robots.txt

De ce robots.txt este un instrument valoros pentru gestionarea site-urilor web

Eficiență sporită a crawl-ului

Ajută motoarele de căutare să se concentreze pe paginile importante, evitând URL-uri inutile sau cu valoare redusă.

Protecția zonelor sensibile

Împiedică crawler-ele să acceseze pagini de login, medii de testare sau instrumente interne.

Reducerea încărcării serverului

Limitează activitatea excesivă a roboților, ajutând la conservarea resurselor serverului și la îmbunătățirea performanței.

Concluzie

Fișierul robots.txt este un instrument SEO puternic, dar delicat. Atunci când este folosit corect, îmbunătățește eficiența de crawl, protejează conținutul sensibil și reduce sarcina inutilă a serverului.

WPZone Robots face gestionarea robots.txt simplă, sigură și transparentă pe WordPress, oferindu-vă control total fără a adăuga complexitate SEO sau dependențe ascunse.

Începeți să folosiți WPZone Robots astăzi și asigurați-vă că motoarele de căutare accesează doar ceea ce contează cu adevărat.

Key Takeaways

- Primul mesaj important de reținut

- Al doilea punct cheie

- A treia perspectivă esențială

WPZone Robots

Gestionați și personalizați cu ușurință fișierul robots.txt din WordPress. Control simplu pentru roboții de căutare.