O Que É um Arquivo robots.txt e Por Que Ele É Importante

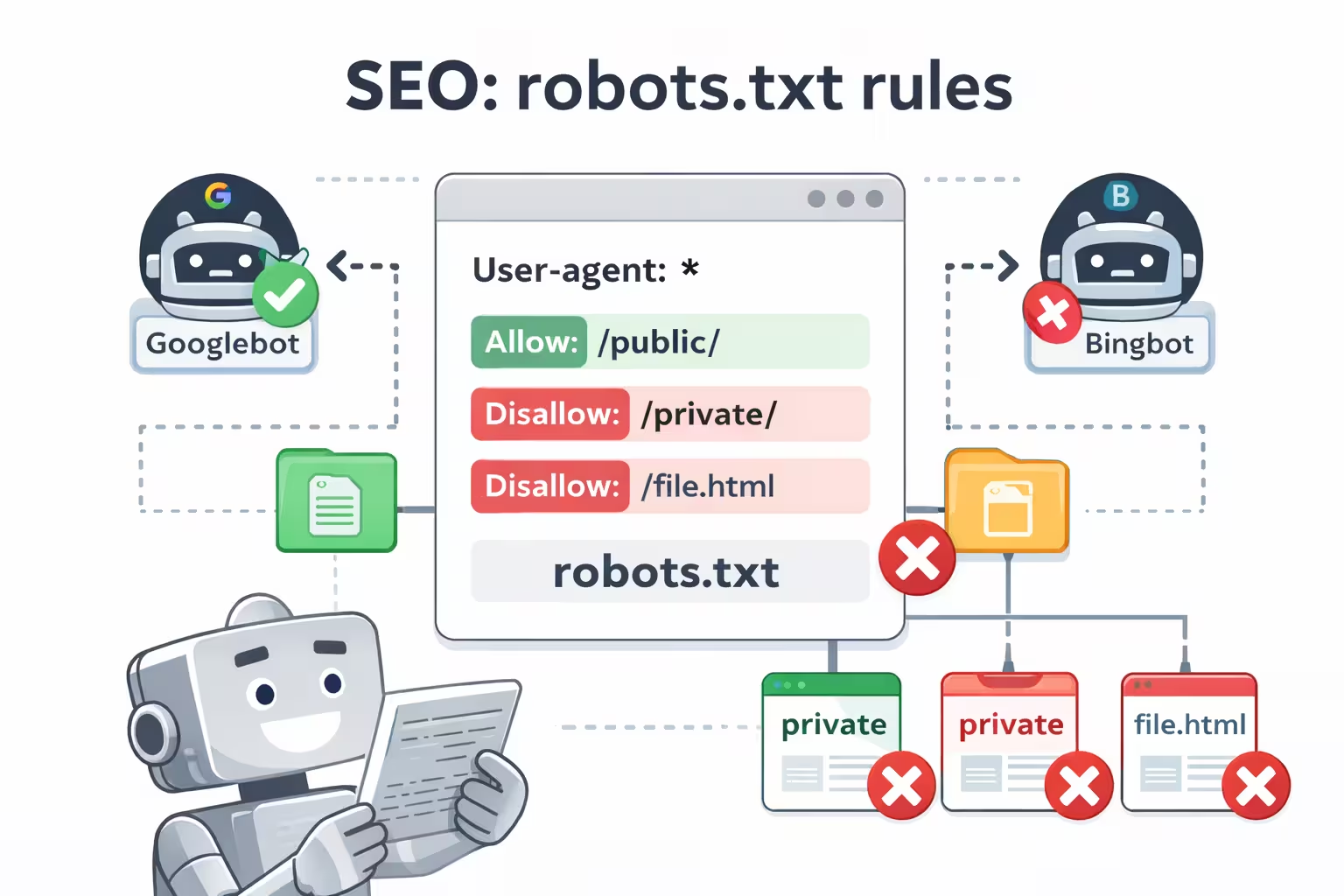

Um arquivo robots.txt é uma ferramenta pequena, mas poderosa, que informa aos mecanismos de busca como rastrear seu site. Ele contém instruções, conhecidas como diretivas, que indicam quais páginas ou seções do seu site os rastreadores têm permissão para acessar e quais devem evitar.

Se nenhum arquivo robots.txt existir, os mecanismos de busca tentarão rastrear todo o site. Embora a maioria dos principais mecanismos de busca respeite as diretivas do robots.txt, elas são consideradas orientações em vez de regras estritas, o que significa que os rastreadores podem às vezes ignorá-las.

Por que o robots.txt é importante para o seu site

De uma perspectiva de SEO, o robots.txt desempenha um papel essencial em orientar como os mecanismos de busca interagem com seu site. Um arquivo robots.txt configurado corretamente ajuda você a:

- Controlar a indexação impedindo que páginas duplicadas ou desnecessárias sejam rastreadas

- Proteger áreas sensíveis como páginas de login, ambientes de teste ou ferramentas internas

- Otimizar recursos do servidor reduzindo o tráfego desnecessário de bots

Importante: Alterações incorretas no robots.txt podem tornar grandes partes do seu site inacessíveis para os mecanismos de busca, o que pode impactar negativamente a visibilidade e o tráfego.

Desafios Comuns do robots.txt

Muitos sites encontram problemas com a configuração do robots.txt. A maioria dos problemas se enquadra em três categorias principais:

- Uso incorreto de curingas que bloqueiam inadvertidamente seções importantes do site

- Alterações inesperadas feitas durante o desenvolvimento ou atualizações do site sem a revisão adequada

- Diretivas não padronizadas que não são reconhecidas pelos mecanismos de busca e não têm efeito real

Esses problemas geralmente ocorrem porque o robots.txt é editado manualmente ou está enterrado dentro de configurações complexas de plugins de SEO.

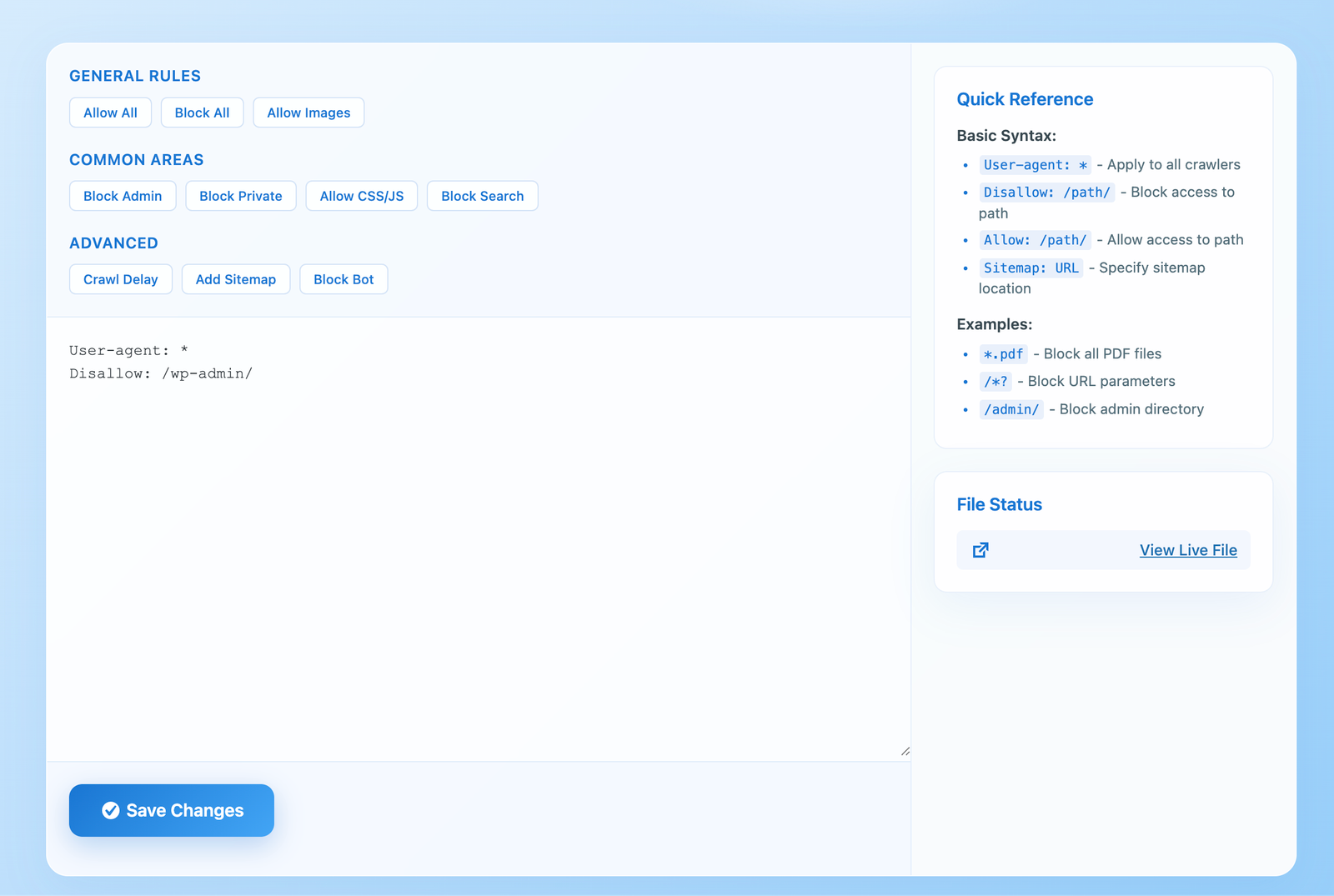

WPZone Robots foi projetado para tornar o gerenciamento de robots.txt simples e previsível para usuários do WordPress. Oferece uma solução independente e focada, sem depender de grandes pacotes de plugins de SEO.

- Editor intuitivo diretamente dentro do painel do WordPress

- Independente de plugins de SEO como Yoast ou Rank Math

- Controle manual completo sobre as regras de acesso de rastreadores

- Leve e focado, sem recursos desnecessários ou bloat de SEO

O WPZone Robots permite que usuários não técnicos gerenciem o acesso de rastreadores com segurança, enquanto oferece a desenvolvedores e proprietários de sites controle previsível sobre seu arquivo robots.txt.

Melhores Práticas para o Seu Arquivo robots.txt

Ao criar ou editar seu arquivo robots.txt, tenha em mente as seguintes melhores práticas:

- Coloque o arquivo na raiz do seu domínio (ex: https://www.example.com/robots.txt)

- Evite bloquear páginas internas importantes que suportam a navegação e a ligação interna

- Limite o uso de diretivas como

crawl-delay, que podem ser ignoradas ou mal interpretadas - Revise regularmente seu arquivo robots.txt para detectar alterações acidentais ou conflitos

Dica: O robots.txt deve ser usado apenas para conteúdo que os motores de busca nunca devem rastrear, como áreas de login, páginas de teste ou URLs geradas automaticamente.

Mantenha-se Atualizado com Wpzone

Obtenha as últimas notícias!

Inscreva-se na nossa newsletter e seja o primeiro a saber sobre novos recursos, atualizações e ofertas exclusivas do nosso aplicativo de reserva de táxi.

We respect your privacy. Unsubscribe at any time.

Desvantagens de Não Usar robots.txt

O que acontece quando o acesso dos rastreadores não é gerenciado

Exposição de áreas não públicas

Páginas de login, seções de teste ou URLs internas podem ser descobertas e rastreadas desnecessariamente.

Controle limitado sobre indexação

Robots.txt controla o rastreamento, não a indexação, e os mecanismos de busca ainda podem indexar URLs bloqueadas.

Recursos desperdiçados e orçamento de rastreamento

Rastreamento excessivo pode consumir recursos do servidor e reduzir a eficiência de indexação para conteúdo importante.

Vantagens de Usar robots.txt

Por que o robots.txt é uma ferramenta valiosa para a gestão de sites

Melhoria na eficiência de rastreamento

Ajuda os mecanismos de busca a focarem em páginas importantes, evitando URLs desnecessárias ou de baixo valor.

Proteção de áreas sensíveis

Impede que rastreadores acessem páginas de login, ambientes de teste ou ferramentas internas.

Redução da carga no servidor

Limita a atividade excessiva de bots, ajudando a preservar os recursos do servidor e melhorar o desempenho.

Conclusão

O arquivo robots.txt é uma ferramenta de SEO poderosa, mas delicada. Quando usado corretamente, melhora a eficiência de rastreamento, protege conteúdo sensível e reduz a carga desnecessária no servidor.

WPZone Robots torna o gerenciamento do robots.txt simples, seguro e transparente no WordPress, dando a você controle total sem adicionar complexidade de SEO ou dependências ocultas.

Comece a usar o WPZone Robots hoje e garanta que os mecanismos de busca rastreiem apenas o que realmente importa.

Key Takeaways

- Primeira conclusão importante

- Segundo ponto-chave

- Terceira percepção essencial

WPZone Robots

Gerencie e personalize facilmente seu robots.txt do WordPress. Controle simples para rastreadores de mecanismos de busca.