Czym jest plik robots.txt i dlaczego ma znaczenie

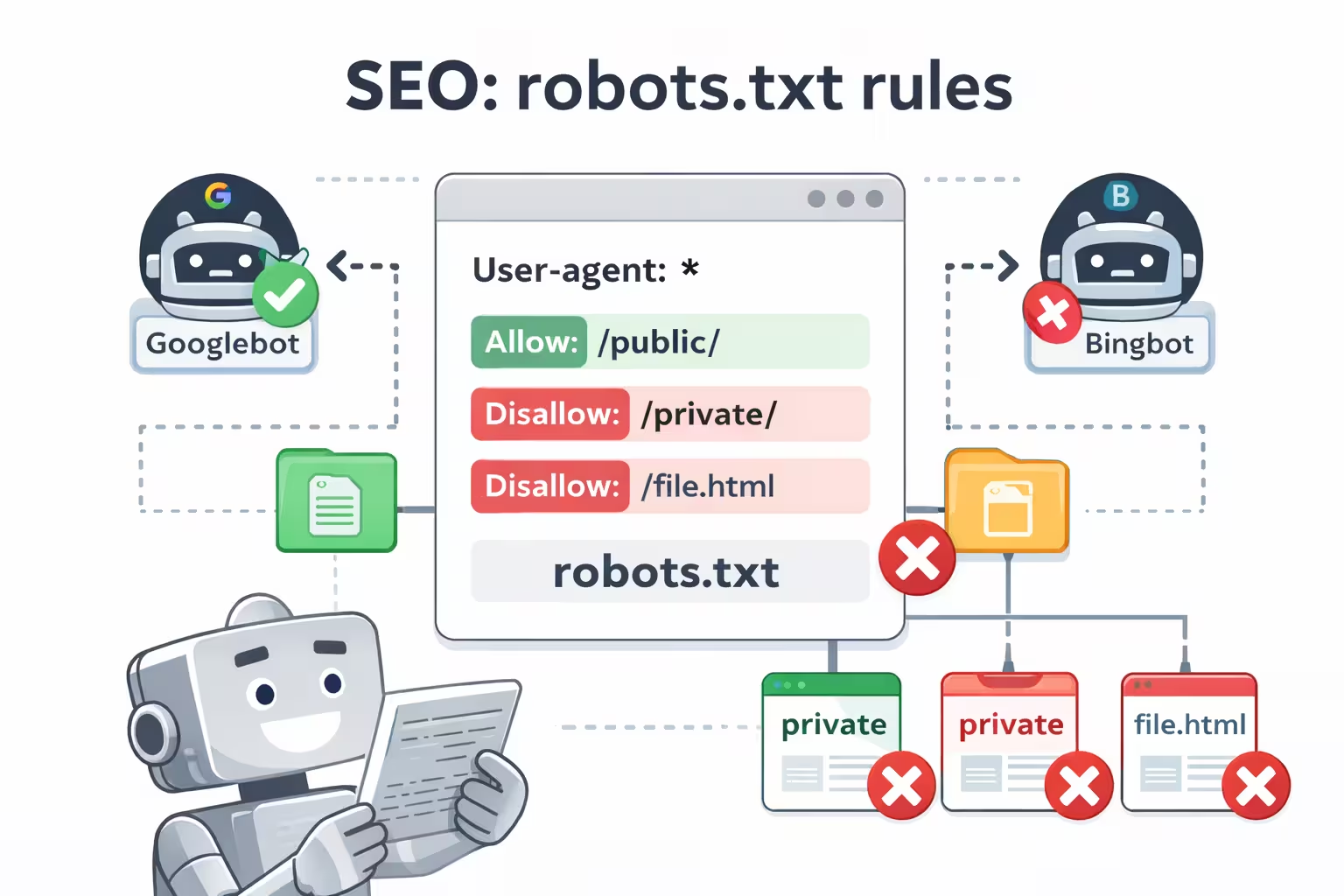

Plik robots.txt to małe, ale potężne narzędzie, które informuje wyszukiwarki, jak mają indeksować Twoją stronę internetową. Zawiera instrukcje, znane jako dyrektywy, które wskazują, do których stron lub sekcji Twojej witryny roboty indeksujące mają dostęp, a których powinny unikać.

Jeśli plik robots.txt nie istnieje, wyszukiwarki będą próbowały przeskanować całą stronę internetową. Chociaż większość głównych wyszukiwarek respektuje dyrektywy robots.txt, są one traktowane jako wytyczne, a nie ścisłe reguły, co oznacza, że roboty indeksujące mogą czasami je ignorować.

Dlaczego robots.txt jest ważny dla Twojej strony

Z perspektywy SEO, robots.txt odgrywa kluczową rolę w kierowaniu interakcji wyszukiwarek z Twoją witryną. Prawidłowo skonfigurowany plik robots.txt pomaga:

- Kontrolować indeksowanie poprzez blokowanie crawlowania zduplikowanych lub niepotrzebnych stron

- Chronić wrażliwe obszary takie jak strony logowania, środowiska testowe lub narzędzia wewnętrzne

- Optymalizować zasoby serwera poprzez redukcję niepotrzecznego ruchu botów

Ważne: Nieprawidłowe zmiany w robots.txt mogą sprawić, że duże części Twojej strony staną się niedostępne dla wyszukiwarek, co może negatywnie wpłynąć na widoczność i ruch.

Typowe wyzwania związane z plikiem robots.txt

Wiele stron internetowych napotyka problemy z konfiguracją pliku robots.txt. Większość problemów można zaliczyć do trzech głównych kategorii:

- Niewłaściwe użycie symboli wieloznacznych, które przypadkowo blokują ważne sekcje witryny

- Nieoczekiwane zmiany wprowadzane podczas rozwoju lub aktualizacji strony bez odpowiedniego przeglądu

- Niestandardowe dyrektywy, które nie są rozpoznawane przez wyszukiwarki i nie mają realnego efektu

Problemy te często występują, ponieważ plik robots.txt jest edytowany ręcznie lub ukryty w złożonych ustawieniach wtyczek SEO.

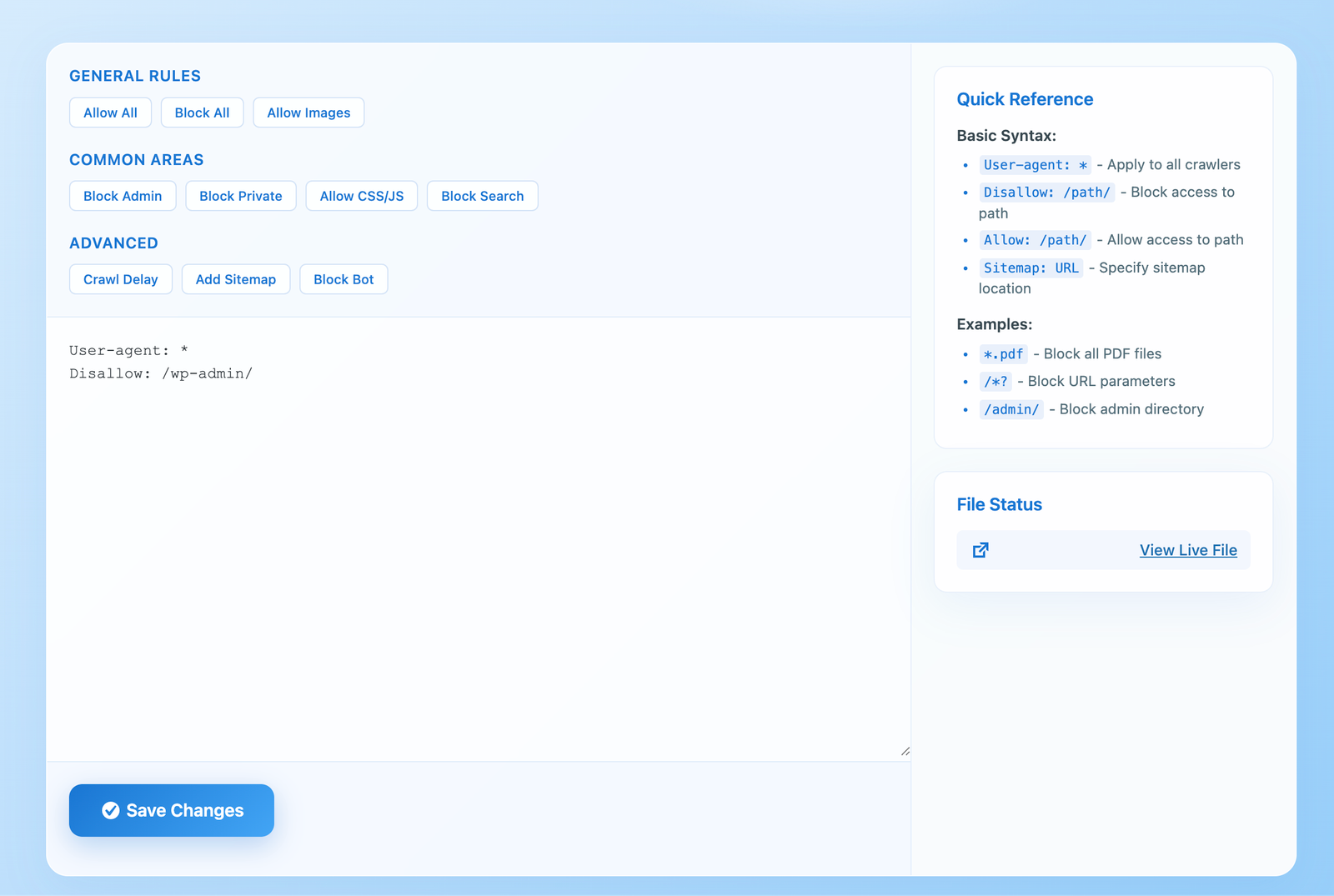

WPZone Robots został zaprojektowany, aby zarządzanie plikiem robots.txt było proste i przewidywalne dla użytkowników WordPressa. Oferuje on ukierunkowane, samodzielne rozwiązanie bez konieczności korzystania z dużych pakietów wtyczek SEO.

- Intuicyjny edytor bezpośrednio w panelu administracyjnym WordPressa

- Niezależność od wtyczek SEO takich jak Yoast czy Rank Math

- Pełna ręczna kontrola nad regułami dostępu dla robotów indeksujących

- Lekki i ukierunkowany, bez zbędnych funkcji czy balastu SEO

WPZone Robots pozwala mniej technicznym użytkownikom bezpiecznie zarządzać dostępem robotów, jednocześnie dając programistom i właścicielom witryn przewidywalną kontrolę nad ich plikiem robots.txt.

Najlepsze praktyki dla pliku robots.txt

Tworząc lub edytując plik robots.txt, pamiętaj o następujących najlepszych praktykach:

- Umieść plik w głównym katalogu domeny (np. https://www.example.com/robots.txt)

- Unikaj blokowania ważnych wewnętrznych stron wspierających nawigację i linkowanie wewnętrzne

- Ogranicz użycie dyrektyw takich jak

crawl-delay, które mogą być ignorowane lub błędnie interpretowane - Regularnie przeglądaj plik robots.txt, aby wykryć przypadkowe zmiany lub konflikty

Wskazówka: Plik robots.txt powinien być używany tylko dla treści, których wyszukiwarki nigdy nie powinny indeksować, takich jak strefy logowania, strony testowe lub automatycznie generowane adresy URL.

Bądź na bieżąco z Wpzone

Otrzymuj najnowsze wiadomości!

Zapisz się do naszego newslettera i bądź pierwszym, który dowie się o nowych funkcjach, aktualizacjach i ekskluzywnych ofertach naszej aplikacji do zamawiania taksówek.

We respect your privacy. Unsubscribe at any time.

Wady braku użycia robots.txt

Co się dzieje, gdy dostęp robotów indeksujących pozostaje niezarządzany

Narażenie niepublicznych obszarów

Strony logowania, sekcje testowe lub wewnętrzne adresy URL mogą zostać niepotrzebnie odkryte i przeskanowane.

Ograniczona kontrola nad indeksowaniem

Robots.txt kontroluje skanowanie, a nie indeksowanie, a wyszukiwarki mogą nadal indeksować zablokowane adresy URL.

Marnowanie zasobów i budżetu skanowania

Nadmierne skanowanie może zużywać zasoby serwera i zmniejszać efektywność indeksowania ważnych treści.

Zalety korzystania z robots.txt

Dlaczego robots.txt to cenne narzędzie w zarządzaniu stroną internetową

Lepsza efektywność indeksowania

Pomaga wyszukiwarkom skupić się na ważnych stronach, unikając niepotrzebnych lub mało wartościowych adresów URL.

Ochrona wrażliwych obszarów

Zapobiega dostępowi robotów do stron logowania, środowisk testowych lub narzędzi wewnętrznych.

Zmniejszone obciążenie serwera

Ogranicza nadmierną aktywność botów, pomagając oszczędzać zasoby serwera i poprawiać wydajność.

Wniosek

Plik robots.txt to potężne, ale delikatne narzędzie SEO. Używany prawidłowo, poprawia efektywność indeksowania, chroni wrażliwe treści i redukuje niepotrzebne obciążenie serwera.

WPZone Robots sprawia, że zarządzanie robots.txt na WordPressie jest proste, bezpieczne i przejrzyste, dając Ci pełną kontrolę bez dodawania skomplikowanych zależności SEO czy ukrytych zależności.

Zacznij korzystać z WPZone Robots już dziś i zapewnij, że wyszukiwarki indeksują tylko to, co naprawdę ważne.

Key Takeaways

- Pierwszy ważny wniosek

- Drugi kluczowy punkt

- Trzecia istotna obserwacja

WPZone Robots

Łatwo zarządzaj i dostosuj swój plik robots.txt w WordPressie. Prosta kontrola dla robotów wyszukiwarek.