Robots.txt per WordPress: Guida Tecnica a Direttive, Regole e Best Practice

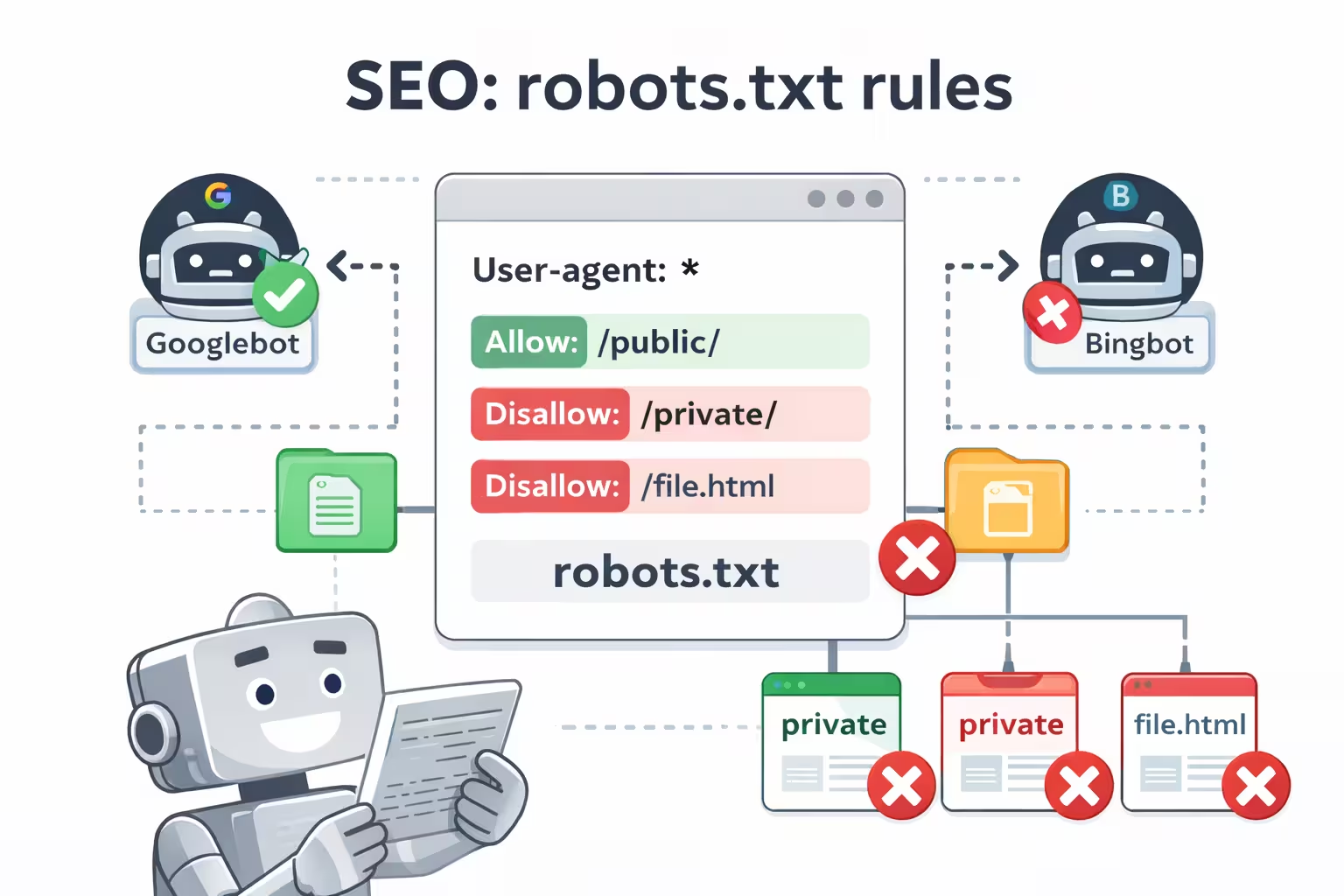

Il file robots.txt è un componente tecnico fondamentale per la SEO e la gestione dei crawler. Sebbene sia spesso trattato come un semplice file di configurazione, svolge un ruolo cruciale nel modo in cui i motori di ricerca e i bot automatizzati interagiscono con un sito web.

Questa guida spiega come funziona il robots.txt, le direttive principali, come i motori di ricerca le interpretano e le migliori pratiche per utilizzare il robots.txt in modo sicuro ed efficace sui siti web WordPress.

Il robots.txt dinamico integrato di WordPress: Come Funziona

A partire da WordPress 5.3, WordPress genera automaticamente un robots.txt virtuale se non esiste un file robots.txt fisico nella root del sito. Questo file viene generato dinamicamente via PHP ed è accessibile all'indirizzo:

https://example.com/robots.txtContenuto Predefinito

1 User-agent: * 2 Disallow: /wp-admin/ 3 Allow: /wp-admin/admin-ajax.php

Cosa Fa

Questo blocca i crawler da /wp-admin/ ma consente le richieste AJAX. Nient'altro è limitato.

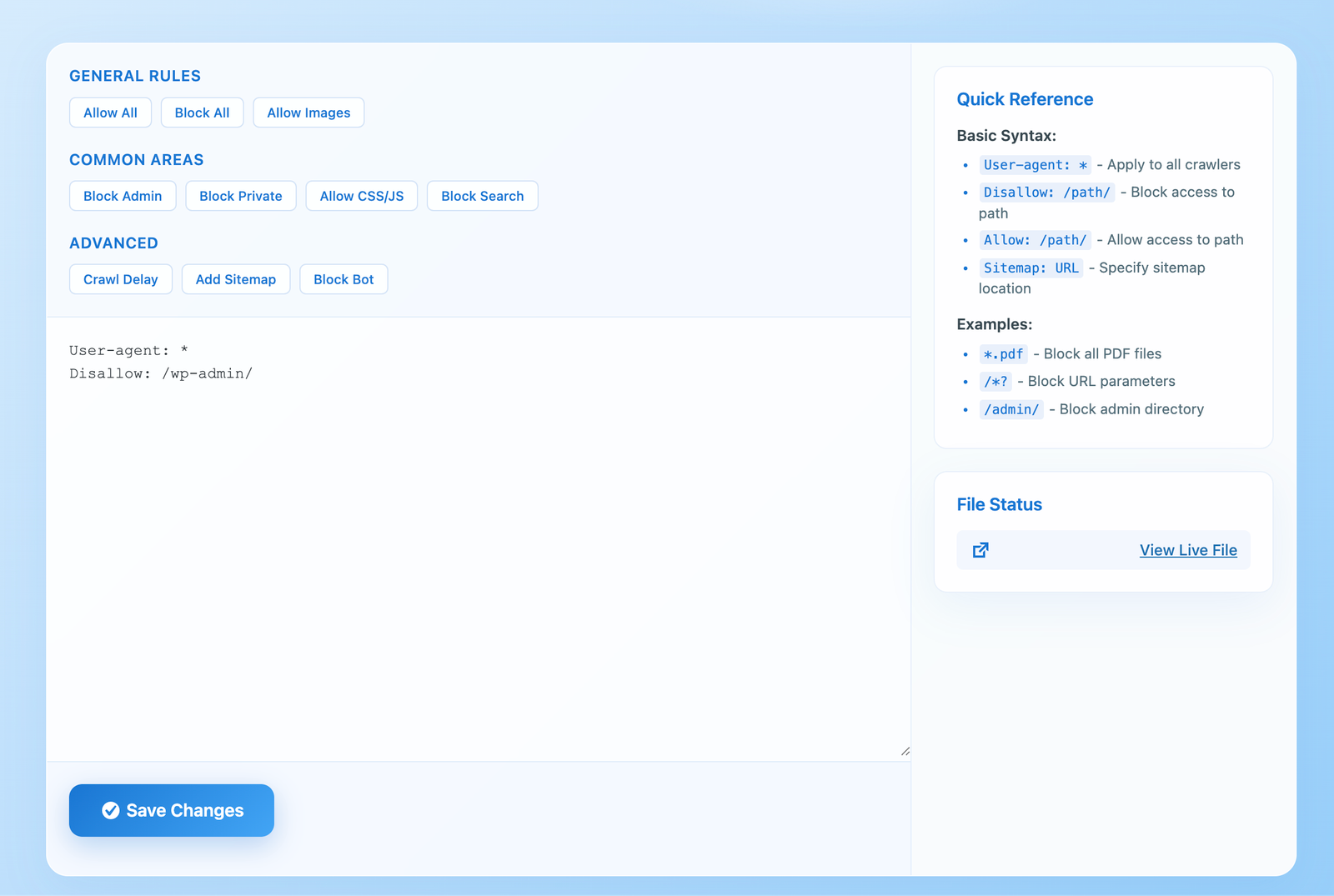

WPZone Robots è progettato per rendere la gestione del file robots.txt semplice e prevedibile per gli utenti di WordPress. Offre una soluzione focalizzata e autonoma, senza dipendere da grandi suite di plugin SEO.

- Editor intuitivo direttamente all'interno della dashboard di WordPress

- Indipendente dai plugin SEO come Yoast o Rank Math

- Controllo manuale completo sulle regole di accesso dei crawler

- Leggero e focalizzato, senza funzionalità superflue o gonfiori SEO

WPZone Robots consente agli utenti non tecnici di gestire in sicurezza l'accesso dei crawler, offrendo al contempo a sviluppatori e proprietari di siti un controllo prevedibile sul loro file robots.txt.

Migliori Pratiche per il Tuo File robots.txt

Quando crei o modifichi il tuo file robots.txt, tieni a mente le seguenti migliori pratiche:

- Posiziona il file nella radice del tuo dominio (es. https://www.example.com/robots.txt)

- Evita di bloccare pagine interne importanti che supportano la navigazione e il collegamento interno

- Limita l'uso di direttive come

crawl-delay, che potrebbero essere ignorate o fraintese - Rivedi regolarmente il tuo file robots.txt per rilevare modifiche accidentali o conflitti

Suggerimento: Robots.txt dovrebbe essere utilizzato solo per contenuti che i motori di ricerca non dovrebbero mai scansionare, come aree di login, pagine di test o URL generati automaticamente.

Rimani Aggiornato con Wpzone

Ricevi le ultime notizie!

Iscriviti alla nostra newsletter e sii il primo a conoscere le nuove funzionalità, gli aggiornamenti e le offerte esclusive per la nostra app di prenotazione taxi.

We respect your privacy. Unsubscribe at any time.

Svantaggi del non utilizzare robots.txt

Cosa succede quando l'accesso dei crawler non viene gestito

Esposizione di aree non pubbliche

Pagine di login, sezioni di test o URL interni potrebbero essere scoperti e scansionati inutilmente.

Controllo limitato sull'indicizzazione

Robots.txt controlla la scansione, non l'indicizzazione, e i motori di ricerca potrebbero comunque indicizzare gli URL bloccati.

Risorse sprecate e budget di scansione

Una scansione eccessiva può consumare risorse del server e ridurre l'efficienza di indicizzazione per i contenuti importanti.

Vantaggi dell'utilizzo di robots.txt

Perché robots.txt è uno strumento prezioso per la gestione del sito web

Migliore efficienza di scansione

Aiuta i motori di ricerca a concentrarsi sulle pagine importanti evitando URL non necessari o a basso valore.

Protezione delle aree sensibili

Impedisce ai crawler di accedere a pagine di login, ambienti di test o strumenti interni.

Riduzione del carico del server

Limita l'attività eccessiva dei bot, contribuendo a preservare le risorse del server e a migliorare le prestazioni.

Conclusione

Il file robots.txt è uno strumento SEO potente ma delicato. Se usato correttamente, migliora l'efficienza del crawling, protegge i contenuti sensibili e riduce il carico non necessario del server.

WPZone Robots rende la gestione di robots.txt semplice, sicura e trasparente su WordPress, dandoti il pieno controllo senza aggiungere complessità SEO o dipendenze nascoste.

Inizia a usare WPZone Robots oggi e assicurati che i motori di ricerca analizzino solo ciò che conta veramente.

Key Takeaways

- Primo importante punto da ricordare

- Secondo punto chiave

- Terza intuizione essenziale

WPZone Robots

Gestisci e personalizza facilmente il tuo robots.txt di WordPress. Controllo semplice per i crawler dei motori di ricerca.