Mi az a robots.txt fájl és miért fontos

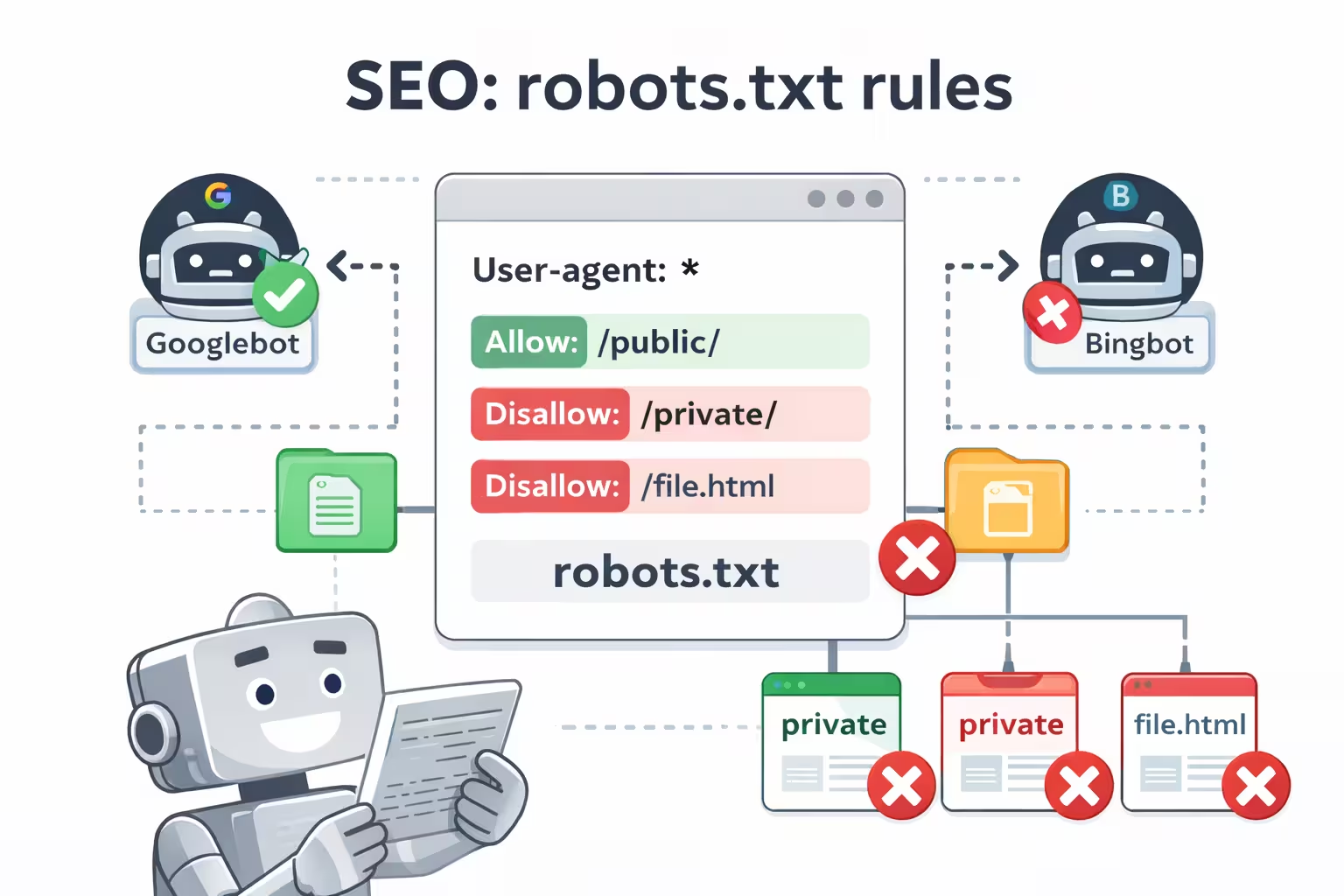

A robots.txt fájl egy kis, de hatékony eszköz, amely megmondja a keresőmotoroknak, hogyan kell bejárniuk a weboldaladat. Olyan utasításokat tartalmaz, amelyeket direktíváknak nevezünk, és amelyek jelzik, hogy a webhely mely oldalait vagy részeit szabad a robotoknak elérniük, és melyeket kerülniük kell.

Ha nem létezik robots.txt fájl, a keresőmotorok megpróbálják bejárni a teljes weboldalt. Bár a legtöbb nagy keresőmotor tiszteletben tartja a robots.txt direktívákat, ezeket iránymutatásoknak tekintik, szigorú szabályok helyett, ami azt jelenti, hogy a robotok néha figyelmen kívül hagyhatják azokat.

Miért fontos a robots.txt a weboldalad számára

SEO szempontból a robots.txt kulcsfontosságú szerepet játszik abban, hogy irányítja a keresőmotorok weboldaladdal való interakcióját. Egy megfelelően konfigurált robots.txt fájl segít:

- Az indexelés irányításában azáltal, hogy megakadályozza a duplikált vagy szükségtelen oldalak bejárását

- Érzékeny területek védelmében, mint például bejelentkezési oldalak, tesztkörnyezetek vagy belső eszközök

- A szerver erőforrások optimalizálásában a szükségtelen bot forgalom csökkentésével

Fontos: A robots.txt fájl helytelen módosítása a weboldalad nagy részei számára elérhetetlenné teheti a keresőmotorok előtt, ami negatívan befolyásolhatja a láthatóságot és a forgalmat.

Gyakori robots.txt kihívások

Számos weboldal találkozik problémákkal a robots.txt konfigurációval. A legtöbb probléma három fő kategóriába sorolható:

- A helyettesítő karakterek helytelen használata, amely véletlenül blokkolja a webhely fontos részeit

- Váratlan változtatások a fejlesztés vagy a weboldalfrissítések során, megfelelő áttekintés nélkül

- Nem szabványos direktívák, amelyeket a keresőmotorok nem ismernek fel és nincs valódi hatásuk

Ezek a problémák gyakran előfordulnak, mert a robots.txt fájlt manuálisan szerkesztik, vagy elrejtik bonyolult SEO bővítmény beállításai között.

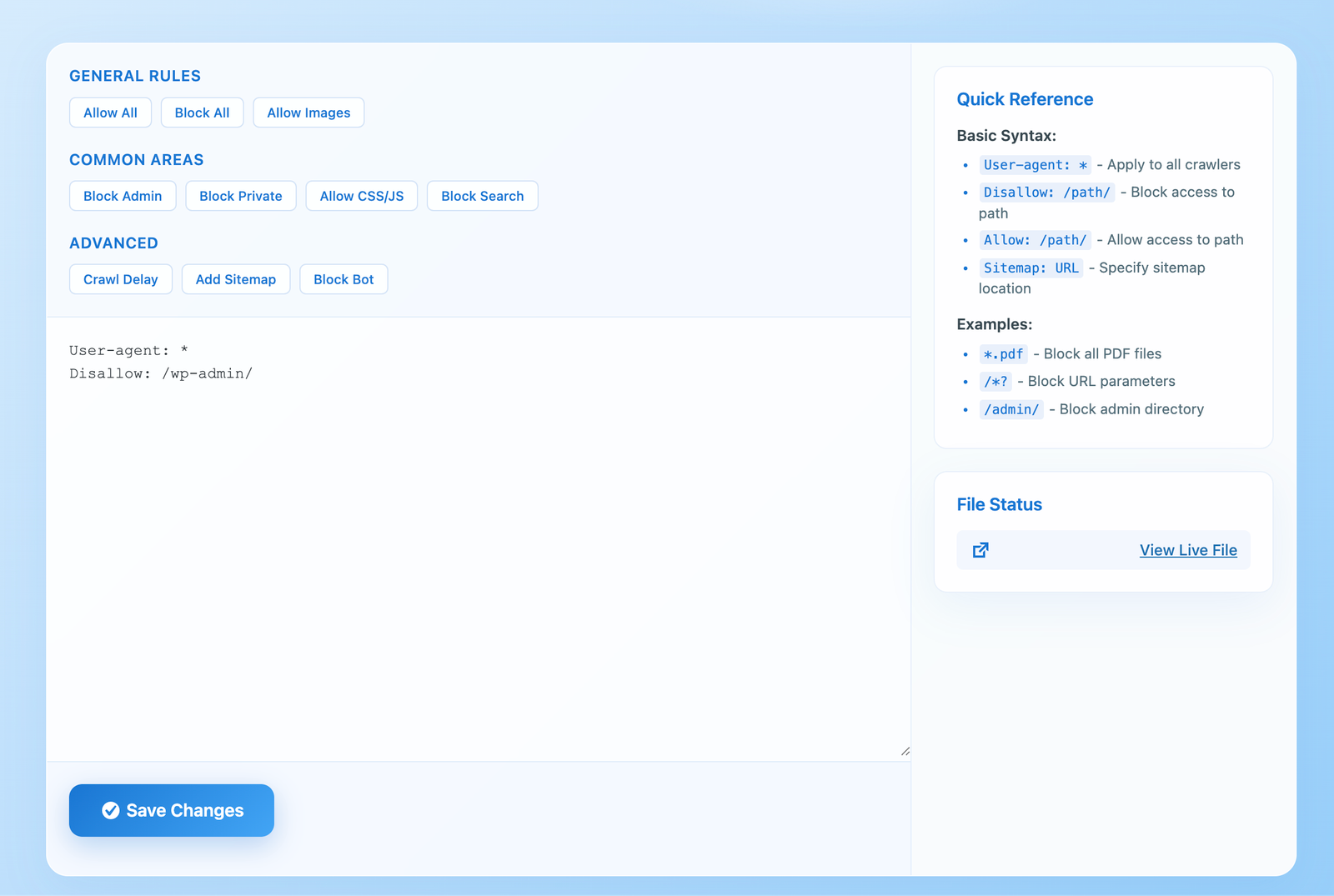

A WPZone Robots célja, hogy a robots.txt kezelését egyszerűvé és kiszámíthatóvá tegye a WordPress felhasználók számára. Egy önálló, fókuszált megoldást kínál, anélkül, hogy nagy SEO bővítménycsomagokra lenne szüksége.

- Intuitív szerkesztő közvetlenül a WordPress vezérlőpulton belül

- Független az SEO bővítményektől, mint például a Yoast vagy a Rank Math

- Teljes kézi irányítás a webkukacok hozzáférési szabályai felett

- Könnyűsúlyú és fókuszált, szükségtelen funkciók vagy SEO terhelés nélkül

A WPZone Robots lehetővé teszi a nem szakmai felhasználók számára a webkukacok hozzáférésének biztonságos kezelését, miközben a fejlesztők és webhelytulajdonosok teljes körű irányítást biztosít a robots.txt fájluk felett.

Ajánlott eljárások a robots.txt fájlhoz

A robots.txt fájl létrehozásakor vagy szerkesztésekor tartsa szem előtt az alábbi ajánlott eljárásokat:

- Helyezze a fájlt a domain gyökerébe (pl. https://www.example.com/robots.txt)

- Kerülje a fontos belső oldalak blokkolását, amelyek a navigációt és belső linkelést támogatják

- Korlátozza az olyan direktívák használatát, mint a

crawl-delay, amelyeket figyelmen kívül hagyhatnak vagy félreértelmezhetnek - Rendszeresen ellenőrizze robots.txt fájlját a véletlen változások vagy ütközések felderítése érdekében

Tipp: A robots.txt fájlt csak olyan tartalomhoz használja, amelyet a keresőmotoroknak soha nem szellőztetnie, mint például bejelentkezési területek, tesztoldalak vagy automatikusan generált URL-ek.

Maradjon naprakész a Wpzone-nál

Kapd el a legfrissebb híreket!

Iratkozzon fel hírlevelünkre, és legyen Ön az első, aki értesül új funkcióinkról, frissítéseinkről és exkluzív ajánlatainkról taxifoglaló alkalmazásunkhoz.

We respect your privacy. Unsubscribe at any time.

A robots.txt nem használatának hátrányai

Mi történik, ha a crawler hozzáférés nincs kezelve

Nem nyilvános területek felfedése

Bejelentkezési oldalak, teszt szakaszok vagy belső URL-ek feleslegesen felfedezhetők és bejárhatók.

Korlátozott ellenőrzés az indexelés felett

A robots.txt a bejárást szabályozza, nem az indexelést, és a keresőmotorok továbbra is indexelhetnek letiltott URL-eket.

Pazarlt erőforrások és crawl költségvetés

A túlzott bejárás kiszívhatja a szerver erőforrásait és csökkentheti a fontos tartalmak indexelési hatékonyságát.

A robots.txt használatának előnyei

Miért értékes eszköz a robots.txt a weboldal-kezelésben

Jobb bejárási hatékonyság

Segít a keresőmotoroknak a fontos oldalakra összpontosítani azáltal, hogy kizárja a felesleges vagy kevésbé értékes URL-eket.

Érzékeny területek védelme

Megakadályozza, hogy a robotok hozzáférjenek bejelentkezési oldalakhoz, tesztkörnyezetekhez vagy belső eszközökhöz.

Csökkentett szerverterhelés

Korlátozza a túlzott bottevékenységet, segítve ezzel a szerver erőforrásainak megóvását és a teljesítmény javítását.

Következtetés

A robots.txt fájl egy erőteljes, de érzékeny SEO eszköz. Ha helyesen használják, javítja a bejárási hatékonyságot, védi a bizalmas tartalmakat, és csökkenti a szükségtelen szerverterhelést.

WPZone Robots egyszerűvé, biztonságossá és átláthatóvá teszi a robots.txt kezelést WordPressen, teljes ellenőrzést adva Önnek anélkül, hogy SEO bonyolultságot vagy rejtett függőségeket adna hozzá.

Kezdje el használni a WPZone Robots-ot még ma, és biztosítsa, hogy a keresőmotorok csak azt járják be, ami valóban számít.

Key Takeaways

- Első fontos tanulság

- Második kulcsfontosságú pont

- Harmadik lényeges betekintés

WPZone Robots

Könnyen kezelheti és testreszabhatja WordPress robots.txt fájlját. Egyszerű irányítás a keresőmotorok robotjai számára.