Qu'est-ce qu'un fichier robots.txt et pourquoi est-il important

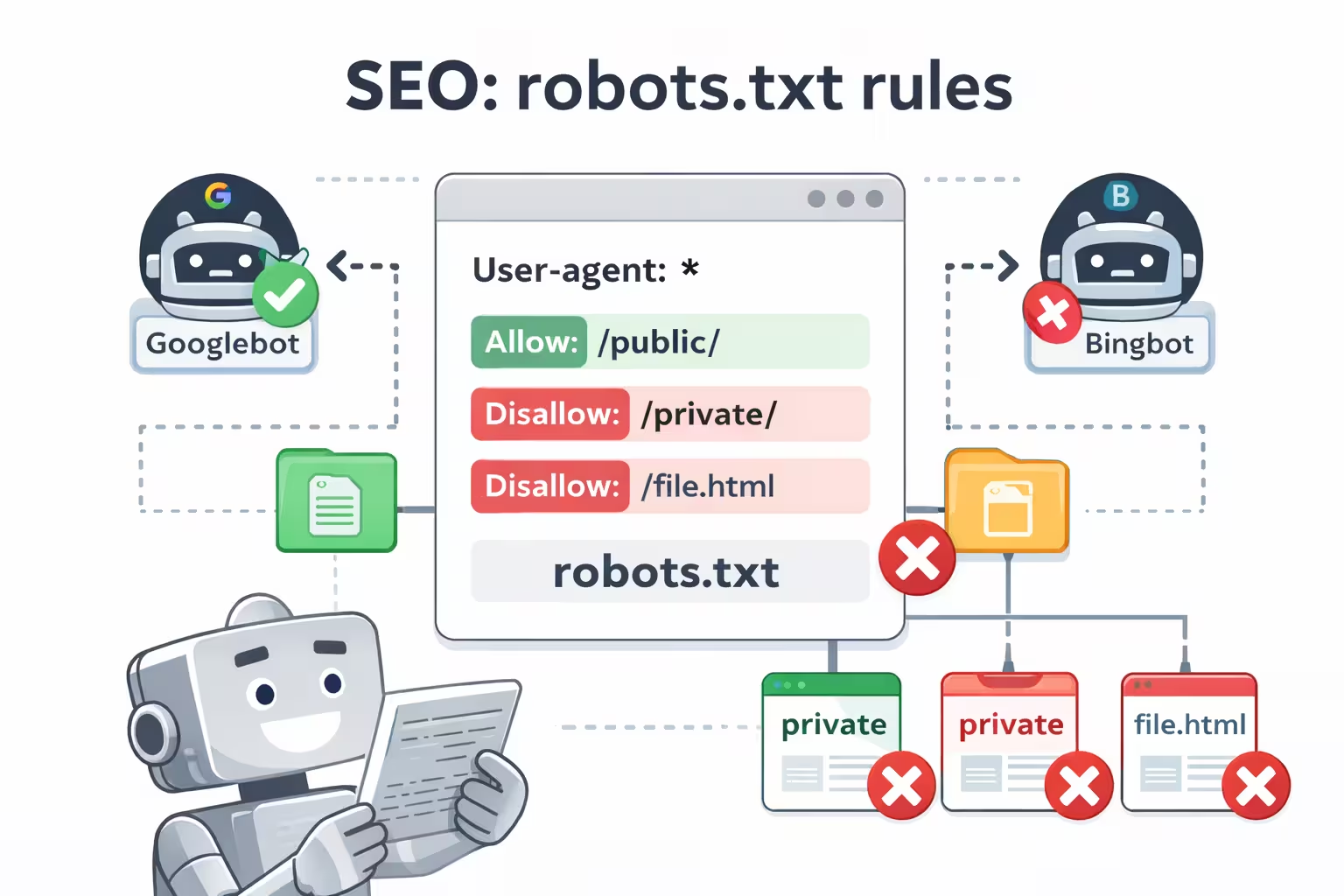

Un fichier robots.txt est un outil petit mais puissant qui indique aux moteurs de recherche comment explorer votre site web. Il contient des instructions, appelées directives, qui indiquent quelles pages ou sections de votre site les robots d'indexation sont autorisés à consulter et lesquelles ils doivent éviter.

Si aucun fichier robots.txt n'existe, les moteurs de recherche tenteront d'explorer l'intégralité du site web. Bien que la plupart des grands moteurs de recherche respectent les directives du robots.txt, elles sont considérées comme des recommandations plutôt que des règles strictes, ce qui signifie que les robots peuvent parfois les ignorer.

Pourquoi robots.txt est important pour votre site

D'un point de vue SEO, robots.txt joue un rôle essentiel pour guider la manière dont les moteurs de recherche interagissent avec votre site. Un fichier robots.txt correctement configuré vous aide à :

- Contrôler l'indexation en empêchant l'exploration de pages en double ou inutiles

- Protéger les zones sensibles telles que les pages de connexion, les environnements de test ou les outils internes

- Optimiser les ressources serveur en réduisant le trafic inutile des robots

Important : Des modifications incorrectes apportées à robots.txt peuvent rendre de grandes parties de votre site web inaccessibles aux moteurs de recherche, ce qui peut nuire à la visibilité et au trafic.

Défis courants du fichier robots.txt

De nombreux sites web rencontrent des problèmes de configuration du robots.txt. La plupart des problèmes se répartissent en trois catégories principales :

- Mauvais usage des caractères génériques qui bloquent involontairement des sections importantes du site

- Modifications inattendues apportées lors du développement ou des mises à jour du site sans examen approprié

- Directives non standard qui ne sont pas reconnues par les moteurs de recherche et n'ont aucun effet réel

Ces problèmes surviennent souvent parce que le robots.txt est modifié manuellement ou caché dans des paramètres complexes de plugins SEO.

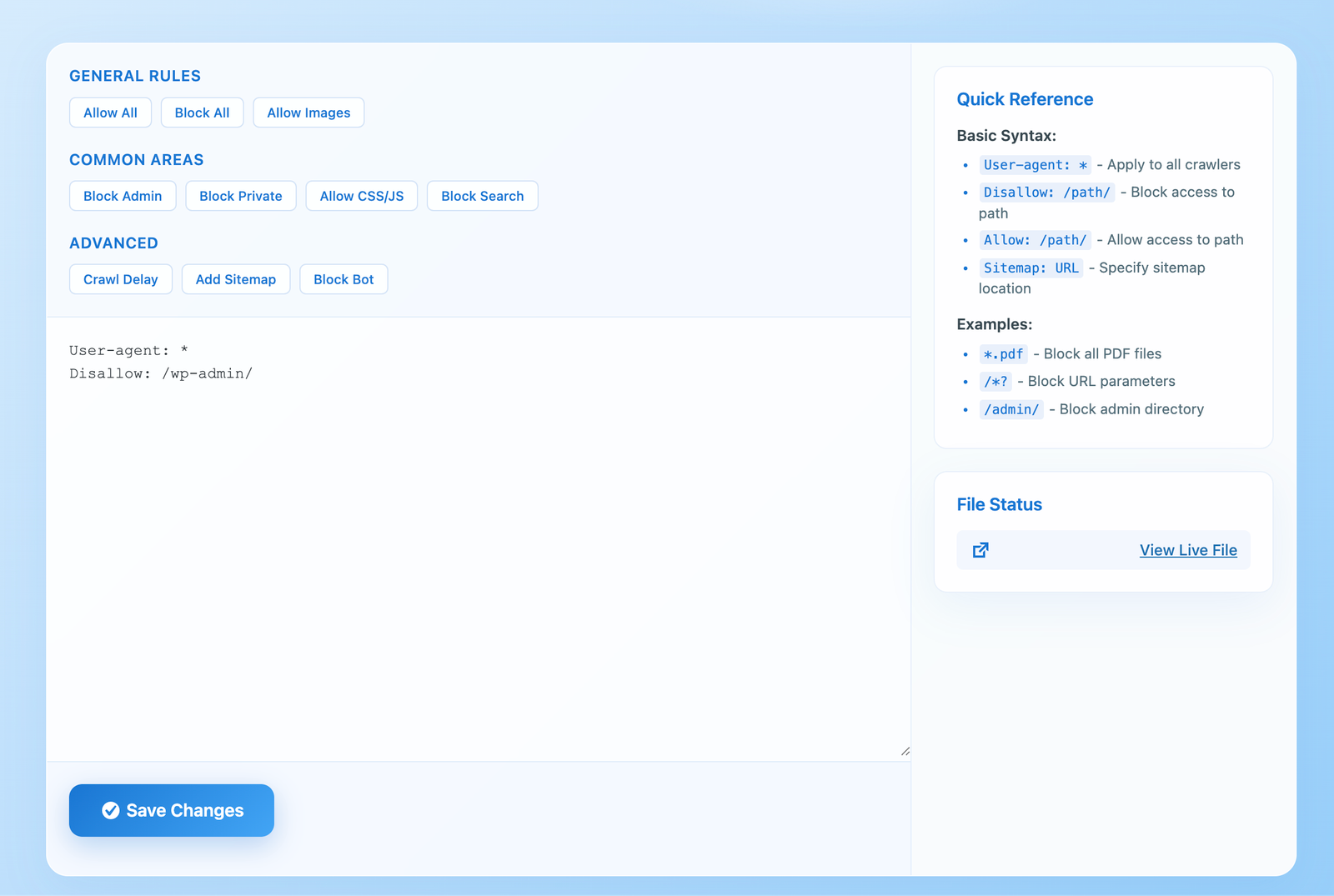

WPZone Robots est conçu pour rendre la gestion du fichier robots.txt simple et prévisible pour les utilisateurs de WordPress. Il offre une solution autonome et ciblée, sans dépendre de suites de plugins SEO volumineuses.

- Éditeur intuitif directement dans le tableau de bord WordPress

- Indépendant des plugins SEO comme Yoast ou Rank Math

- Contrôle manuel complet sur les règles d'accès des robots d'indexation

- Léger et ciblé, sans fonctionnalités superflues ni surcharge SEO

WPZone Robots permet aux utilisateurs non techniques de gérer l'accès des robots en toute sécurité, tout en offrant aux développeurs et propriétaires de sites un contrôle prévisible sur leur fichier robots.txt.

Bonnes pratiques pour votre fichier robots.txt

Lors de la création ou de la modification de votre fichier robots.txt, gardez à l'esprit les bonnes pratiques suivantes :

- Placez le fichier à la racine de votre domaine (par ex. https://www.example.com/robots.txt)

- Évitez de bloquer des pages internes importantes qui soutiennent la navigation et les liens internes

- Limitez l'utilisation de directives comme

crawl-delay, qui peuvent être ignorées ou mal interprétées - Revoyez régulièrement votre fichier robots.txt pour détecter des modifications accidentelles ou des conflits

Astuce : Robots.txt ne doit être utilisé que pour le contenu que les moteurs de recherche ne doivent jamais explorer, comme les zones de connexion, les pages de test ou les URL générées automatiquement.

Restez Informé avec Wpzone

Obtenez les dernières nouvelles !

Abonnez-vous à notre newsletter et soyez les premiers informés des nouvelles fonctionnalités, mises à jour et offres exclusives de notre application de réservation de taxi.

We respect your privacy. Unsubscribe at any time.

Inconvénients de ne pas utiliser robots.txt

Ce qui se passe lorsque l'accès des robots d'indexation n'est pas géré

Exposition de zones non publiques

Les pages de connexion, sections de test ou URLs internes peuvent être découvertes et explorées inutilement.

Contrôle limité sur l'indexation

Robots.txt contrôle l'exploration, pas l'indexation, et les moteurs de recherche peuvent toujours indexer les URLs bloquées.

Ressources gaspillées et budget d'exploration

Une exploration excessive peut consommer les ressources du serveur et réduire l'efficacité d'indexation du contenu important.

Avantages de l'utilisation de robots.txt

Pourquoi robots.txt est un outil précieux pour la gestion de site web

Amélioration de l'efficacité du crawl

Aide les moteurs de recherche à se concentrer sur les pages importantes en évitant les URL inutiles ou de faible valeur.

Protection des zones sensibles

Empêche les robots d'accéder aux pages de connexion, environnements de test ou outils internes.

Réduction de la charge serveur

Limite l'activité excessive des bots, aidant à préserver les ressources serveur et à améliorer les performances.

Conclusion

Le fichier robots.txt est un outil SEO puissant mais délicat. Utilisé correctement, il améliore l'efficacité du crawl, protège le contenu sensible et réduit la charge inutile du serveur.

WPZone Robots rend la gestion de robots.txt simple, sûre et transparente sur WordPress, vous offrant un contrôle total sans ajouter de complexité SEO ou de dépendances cachées.

Commencez à utiliser WPZone Robots dès aujourd'hui et assurez-vous que les moteurs de recherche crawleront uniquement ce qui compte vraiment.

Key Takeaways

- Première conclusion importante

- Deuxième point clé

- Troisième aperçu essentiel

WPZone Robots

Gérez et personnalisez facilement votre fichier robots.txt WordPress. Un contrôle simple pour les robots d'exploration des moteurs de recherche.