Qué es un archivo robots.txt y por qué es importante

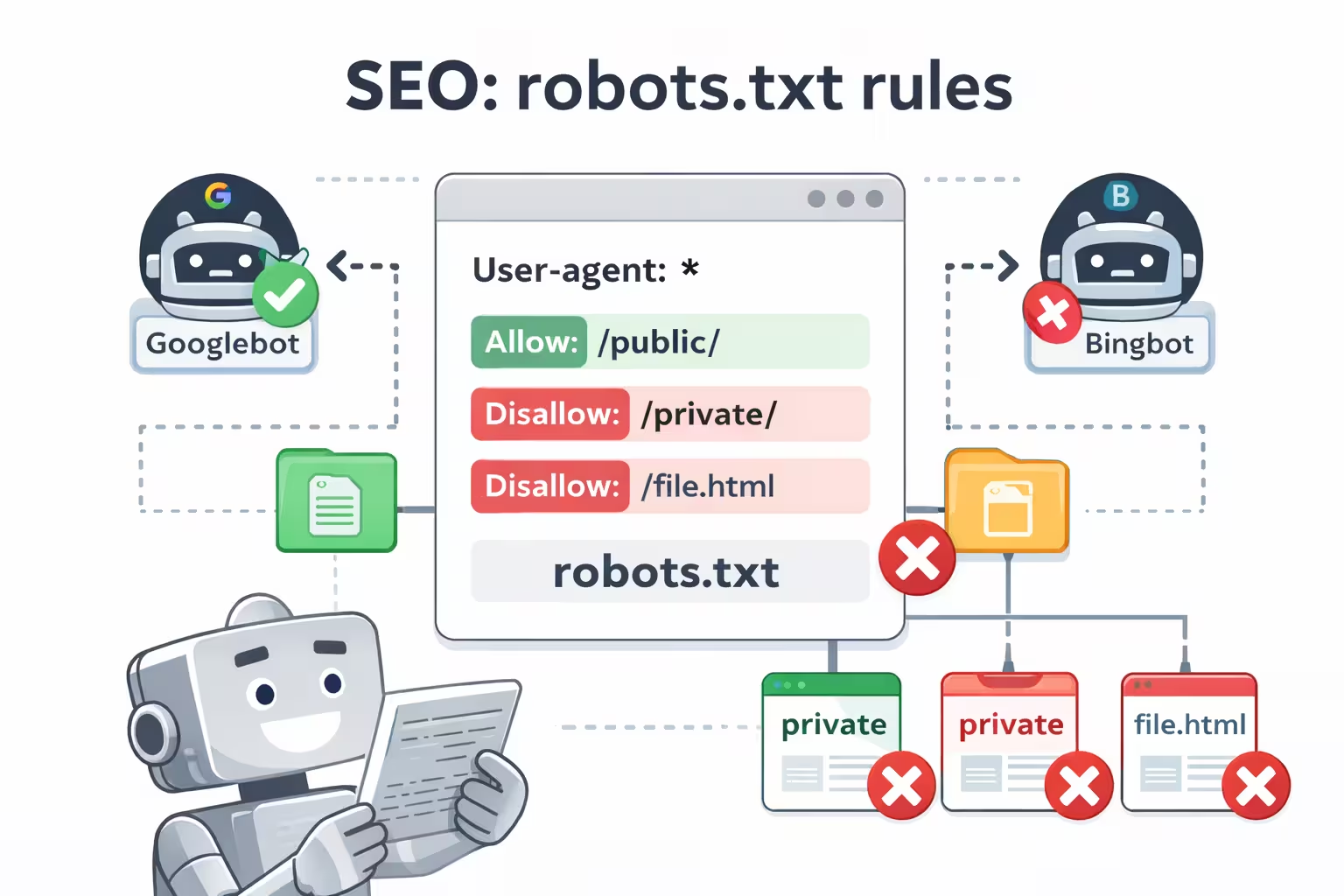

Un archivo robots.txt es una herramienta pequeña pero poderosa que le indica a los motores de búsqueda cómo rastrear su sitio web. Contiene instrucciones, conocidas como directivas, que indican qué páginas o secciones de su sitio los rastreadores pueden acceder y cuáles deben evitar.

Si no existe un archivo robots.txt, los motores de búsqueda intentarán rastrear todo el sitio web. Aunque la mayoría de los principales motores de búsqueda respetan las directivas de robots.txt, se consideran pautas en lugar de reglas estrictas, lo que significa que los rastreadores a veces pueden ignorarlas.

Por qué robots.txt es importante para tu sitio

Desde una perspectiva SEO, robots.txt juega un papel esencial al guiar cómo los motores de búsqueda interactúan con tu sitio. Un archivo robots.txt configurado correctamente te ayuda a:

- Controlar la indexación al evitar que se rastreen páginas duplicadas o innecesarias

- Proteger áreas sensibles como páginas de inicio de sesión, entornos de prueba o herramientas internas

- Optimizar los recursos del servidor al reducir el tráfico innecesario de bots

Importante: Cambios incorrectos en robots.txt pueden hacer que grandes partes de tu sitio web sean inaccesibles para los motores de búsqueda, lo que puede afectar negativamente la visibilidad y el tráfico.

Desafíos comunes de robots.txt

Muchos sitios web encuentran problemas con la configuración de robots.txt. La mayoría de los problemas se engloban en tres categorías principales:

- Uso incorrecto de comodines que bloquean involuntariamente secciones importantes del sitio

- Cambios inesperados realizados durante el desarrollo o actualizaciones del sitio sin una revisión adecuada

- Directivas no estándar que no son reconocidas por los motores de búsqueda y no tienen ningún efecto real

Estos problemas suelen ocurrir porque el robots.txt se edita manualmente o está enterrado dentro de configuraciones complejas de plugins de SEO.

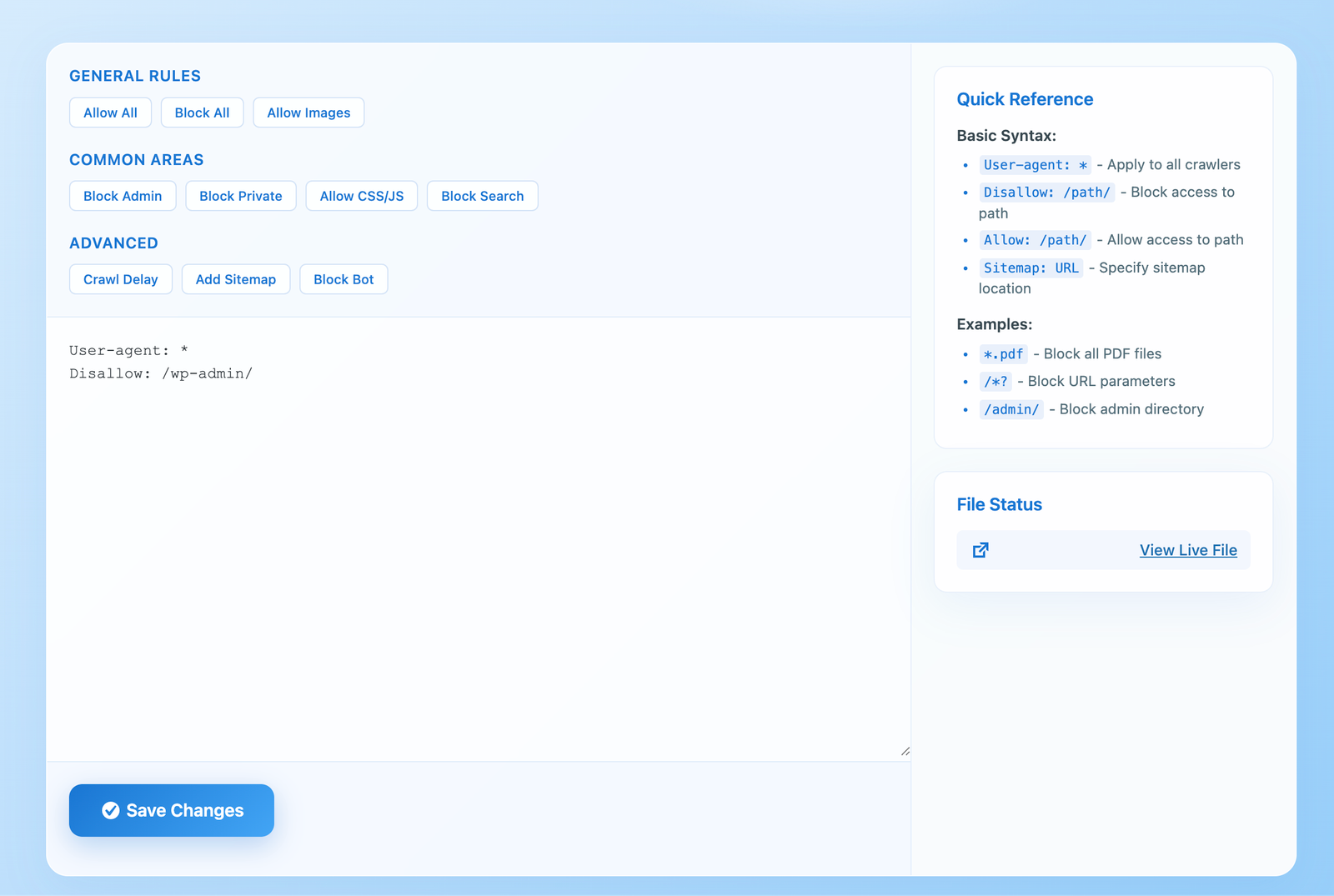

WPZone Robots está diseñado para hacer que la gestión de robots.txt sea sencilla y predecible para los usuarios de WordPress. Ofrece una solución enfocada e independiente, sin depender de grandes suites de plugins SEO.

- Editor intuitivo directamente dentro del panel de control de WordPress

- Independiente de plugins SEO como Yoast o Rank Math

- Control manual completo sobre las reglas de acceso de los rastreadores

- Ligero y enfocado, sin funciones innecesarias ni bloat SEO

WPZone Robots permite a usuarios no técnicos gestionar el acceso de los rastreadores de forma segura, mientras otorga a desarrolladores y propietarios de sitios un control predecible sobre su archivo robots.txt.

Mejores Prácticas para Tu Archivo robots.txt

Al crear o editar tu archivo robots.txt, ten en cuenta las siguientes mejores prácticas:

- Coloca el archivo en la raíz de tu dominio (ej. https://www.example.com/robots.txt)

- Evita bloquear páginas internas importantes que soporten la navegación y los enlaces internos

- Limita el uso de directivas como

crawl-delay, que pueden ser ignoradas o malinterpretadas - Revisa regularmente tu archivo robots.txt para detectar cambios accidentales o conflictos

Consejo: Robots.txt solo debe usarse para contenido que los motores de búsqueda nunca deben rastrear, como áreas de inicio de sesión, páginas de prueba o URLs generadas automáticamente.

Mantente Actualizado con Wpzone

¡Obtén las últimas noticias!

Suscríbete a nuestro boletín y sé el primero en enterarte de nuevas funciones, actualizaciones y ofertas exclusivas para nuestra aplicación de reserva de taxis.

We respect your privacy. Unsubscribe at any time.

Contras de no usar robots.txt

Qué sucede cuando el acceso de los rastreadores no se gestiona

Exposición de áreas no públicas

Páginas de inicio de sesión, secciones de prueba o URLs internas pueden ser descubiertas y rastreadas innecesariamente.

Control limitado sobre la indexación

Robots.txt controla el rastreo, no la indexación, y los motores de búsqueda aún pueden indexar URLs bloqueadas.

Recursos y presupuesto de rastreo desperdiciados

Un rastreo excesivo puede consumir recursos del servidor y reducir la eficiencia de indexación para contenido importante.

Ventajas de usar robots.txt

Por qué robots.txt es una herramienta valiosa para la gestión de sitios web

Mejora de la eficiencia del rastreo

Ayuda a los motores de búsqueda a centrarse en páginas importantes evitando URLs innecesarias o de bajo valor.

Protección de áreas sensibles

Impide que los rastreadores accedan a páginas de inicio de sesión, entornos de prueba o herramientas internas.

Reducción de la carga del servidor

Limita la actividad excesiva de bots, ayudando a preservar los recursos del servidor y mejorar el rendimiento.

Conclusión

El archivo robots.txt es una herramienta de SEO potente pero delicada. Cuando se usa correctamente, mejora la eficiencia del rastreo, protege el contenido sensible y reduce la carga innecesaria del servidor.

WPZone Robots hace que la gestión de robots.txt sea simple, segura y transparente en WordPress, dándote control total sin añadir complejidad SEO o dependencias ocultas.

Comienza a usar WPZone Robots hoy y asegúrate de que los motores de búsqueda rastreen solo lo que realmente importa.

Key Takeaways

- Primera conclusión importante

- Segundo punto clave

- Tercera idea esencial

WPZone Robots

Gestiona y personaliza fácilmente tu robots.txt de WordPress. Control sencillo para los rastreadores de motores de búsqueda.