Was eine robots.txt-Datei ist und warum sie wichtig ist

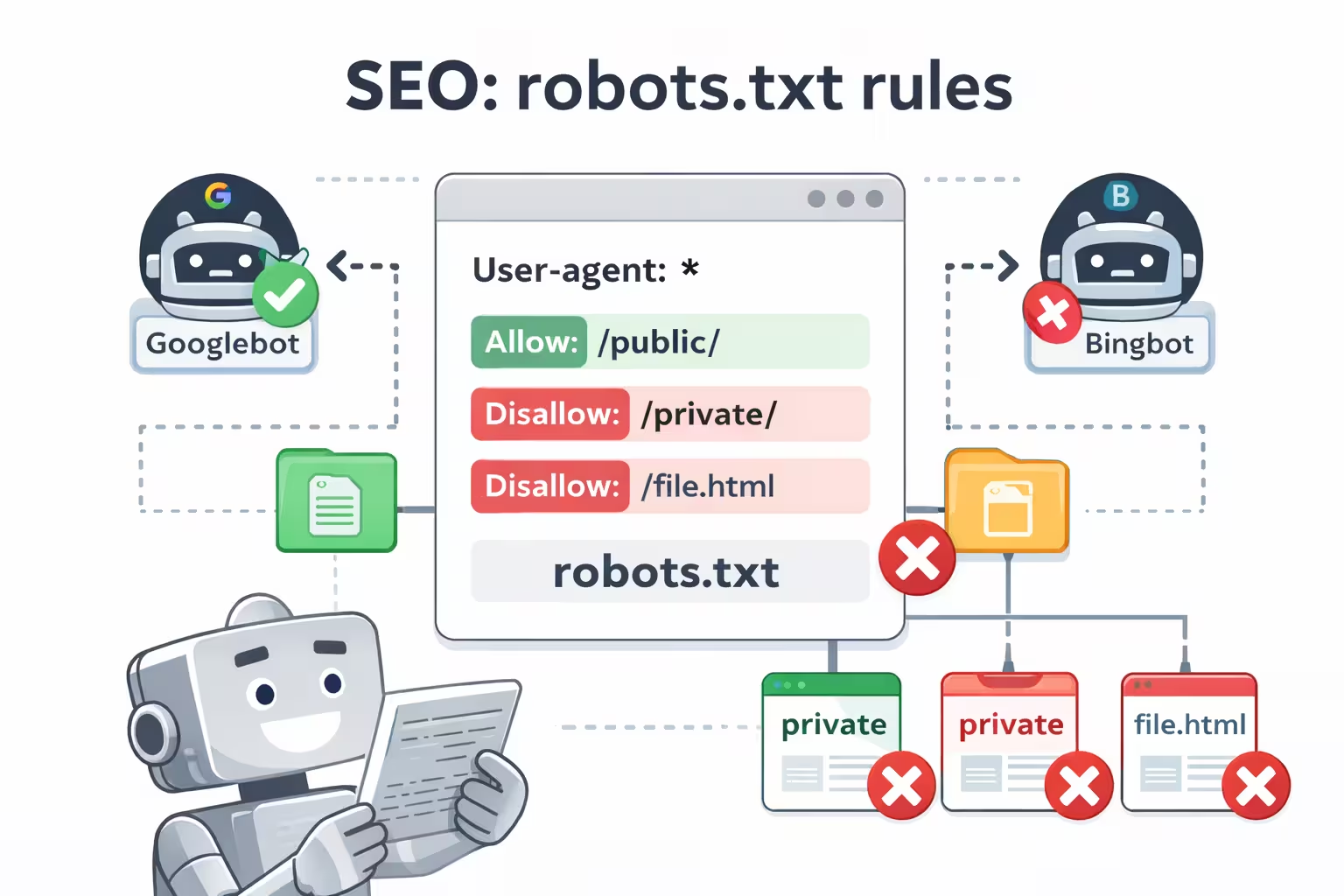

Eine robots.txt-Datei ist ein kleines, aber leistungsstarkes Werkzeug, das Suchmaschinen mitteilt, wie sie Ihre Website durchsuchen sollen. Sie enthält Anweisungen, sogenannte Direktiven, die angeben, auf welche Seiten oder Bereiche Ihrer Website Crawler zugreifen dürfen und welche sie meiden sollten.

Wenn keine robots.txt-Datei existiert, werden Suchmaschinen versuchen, die gesamte Website zu durchsuchen. Während die meisten großen Suchmaschinen robots.txt-Direktiven respektieren, gelten sie als Richtlinien und nicht als strenge Regeln, was bedeutet, dass Crawler sie manchmal ignorieren können.

Warum robots.txt für Ihre Website wichtig ist

Aus SEO-Sicht spielt robots.txt eine wesentliche Rolle dabei, wie Suchmaschinen mit Ihrer Website interagieren. Eine korrekt konfigurierte robots.txt-Datei hilft Ihnen dabei:

- Die Indexierung steuern, indem verhindert wird, dass doppelte oder unnötige Seiten gecrawlt werden

- Sensible Bereiche schützen, wie Login-Seiten, Testumgebungen oder interne Tools

- Serverressourcen optimieren, indem unnötiger Bot-Traffic reduziert wird

Wichtig: Falsche Änderungen an der robots.txt können große Teile Ihrer Website für Suchmaschinen unzugänglich machen, was sich negativ auf die Sichtbarkeit und den Traffic auswirken kann.

Häufige robots.txt-Herausforderungen

Viele Websites stoßen auf Probleme mit der robots.txt-Konfiguration. Die meisten Probleme lassen sich in drei Hauptkategorien einteilen:

- Fehlgebrauch von Wildcards, die unbeabsichtigt wichtige Bereiche der Website blockieren

- Unerwartete Änderungen, die während der Entwicklung oder bei Site-Updates ohne angemessene Überprüfung vorgenommen werden

- Nicht standardkonforme Direktiven, die von Suchmaschinen nicht erkannt werden und keine wirkliche Wirkung entfalten

Diese Probleme treten oft auf, weil die robots.txt manuell bearbeitet wird oder in komplexen SEO-Plugin-Einstellungen versteckt ist.

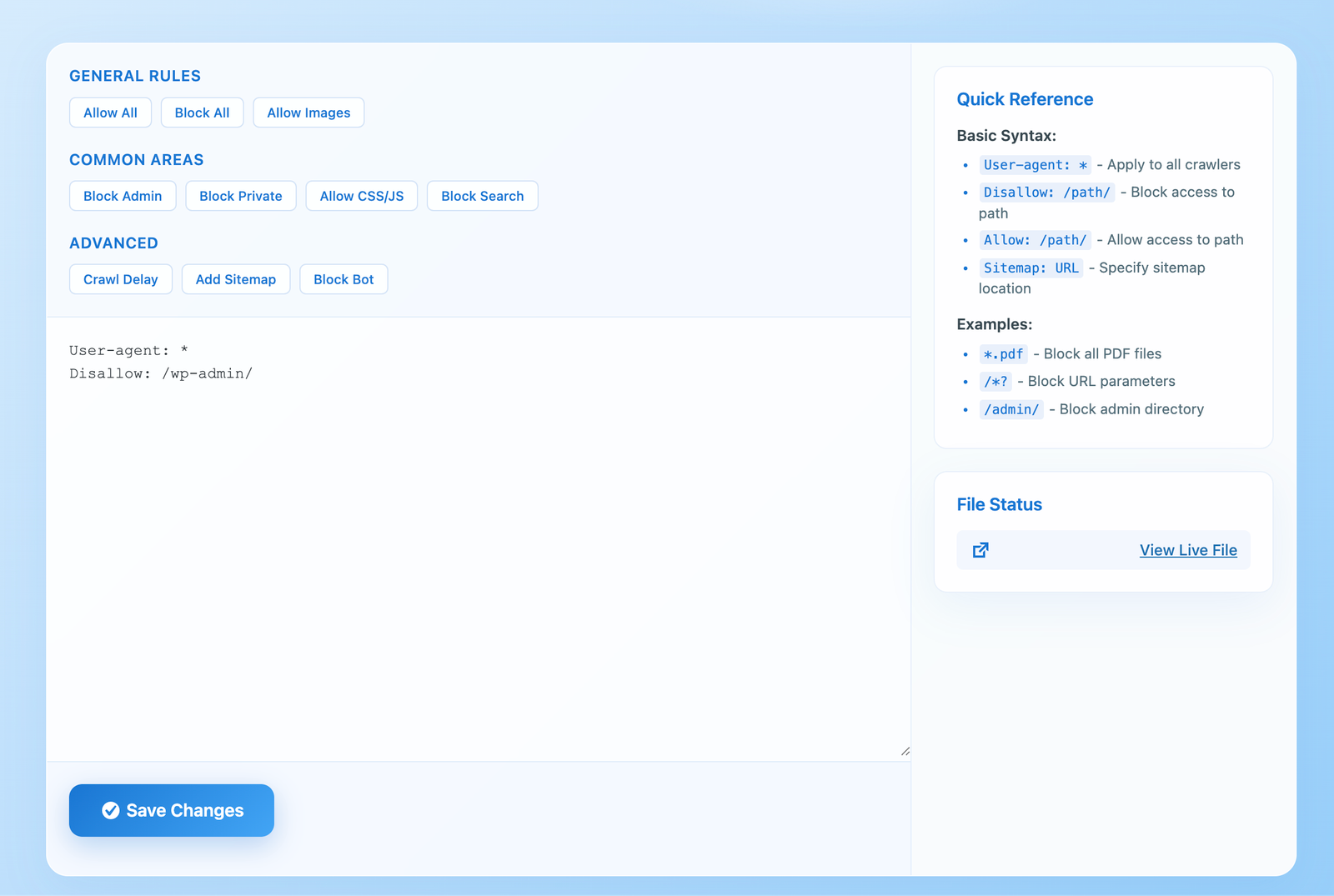

WPZone Robots ist darauf ausgelegt, die Verwaltung von robots.txt für WordPress-Benutzer unkompliziert und vorhersehbar zu gestalten. Es bietet eine fokussierte, eigenständige Lösung, ohne auf große SEO-Plugin-Suiten angewiesen zu sein.

- Intuitiver Editor direkt im WordPress-Dashboard

- Unabhängig von SEO-Plugins wie Yoast oder Rank Math

- Vollständige manuelle Kontrolle über Crawler-Zugriffsregeln

- Leichtgewichtig und fokussiert, ohne unnötige Funktionen oder SEO-Ballast

WPZone Robots ermöglicht es technisch nicht versierten Benutzern, den Crawler-Zugriff sicher zu verwalten, während es Entwicklern und Seitenbetreibern eine vorhersehbare Kontrolle über ihre robots.txt-Datei gibt.

Bewährte Verfahren für Ihre robots.txt-Datei

Beachten Sie beim Erstellen oder Bearbeiten Ihrer robots.txt-Datei folgende bewährte Verfahren:

- Platzieren Sie die Datei im Stammverzeichnis Ihrer Domain (z.B. https://www.example.com/robots.txt)

- Vermeiden Sie das Blockieren wichtiger interner Seiten, die Navigation und interne Verlinkung unterstützen

- Beschränken Sie die Verwendung von Direktiven wie

crawl-delay, die ignoriert oder falsch interpretiert werden können - Überprüfen Sie Ihre robots.txt-Datei regelmäßig, um versehentliche Änderungen oder Konflikte zu erkennen

Tipp: Robots.txt sollte nur für Inhalte verwendet werden, die Suchmaschinen niemals crawlen sollten, wie Login-Bereiche, Testseiten oder automatisch generierte URLs.

Bleiben Sie mit Wpzone auf dem Laufenden

Holen Sie sich die neuesten Nachrichten!

Abonnieren Sie unseren Newsletter und erfahren Sie als Erster von neuen Funktionen, Updates und exklusiven Angeboten für unsere Taxibuchungs-App.

We respect your privacy. Unsubscribe at any time.

Nachteile der Nichtnutzung von robots.txt

Was passiert, wenn der Zugriff von Crawlern unkontrolliert bleibt

Freilegung nicht-öffentlicher Bereiche

Login-Seiten, Testbereiche oder interne URLs können unnötigerweise entdeckt und gecrawlt werden.

Eingeschränkte Kontrolle über die Indexierung

Robots.txt steuert das Crawling, nicht die Indexierung, und Suchmaschinen können blockierte URLs dennoch indexieren.

Verschwendete Ressourcen und Crawl-Budget

Übermäßiges Crawling kann Serverressourcen verbrauchen und die Indexierungseffizienz für wichtige Inhalte verringern.

Vorteile der Verwendung von robots.txt

Warum robots.txt ein wertvolles Tool für das Website-Management ist

Verbesserte Crawling-Effizienz

Hilft Suchmaschinen, sich auf wichtige Seiten zu konzentrieren, indem unnötige oder minderwertige URLs vermieden werden.

Schutz sensibler Bereiche

Verhindert, dass Crawler auf Login-Seiten, Testumgebungen oder interne Tools zugreifen.

Reduzierte Serverlast

Begrenzt übermäßige Bot-Aktivität, hilft Serverressourcen zu schonen und die Leistung zu verbessern.

Fazit

Die robots.txt-Datei ist ein leistungsstarkes, aber empfindliches SEO-Werkzeug. Bei korrekter Anwendung verbessert sie die Crawling-Effizienz, schützt sensible Inhalte und reduziert unnötige Serverlast.

WPZone Robots macht die robots.txt-Verwaltung auf WordPress einfach, sicher und transparent, und gibt Ihnen die volle Kontrolle, ohne SEO-Komplexität oder versteckte Abhängigkeiten hinzuzufügen.

Beginnen Sie noch heute mit WPZone Robots und stellen Sie sicher, dass Suchmaschinen nur das crawlen, was wirklich wichtig ist.

Key Takeaways

- Erste wichtige Erkenntnis

- Zweiter zentraler Punkt

- Dritte wesentliche Einsicht

WPZone Robots

Einfache Verwaltung und Anpassung Ihrer WordPress robots.txt. Einfache Kontrolle für Suchmaschinen-Crawler.